Anthropic vs. US Department of War

El Especial WMC:

La reciente escalada en la confrontación entre Anthropic, una de las corporaciones tecnológicas más recientemente renombrada del ecosistema global, y el Departamento de Guerra la Los Estados Unidos representa un importante caso de estudio sobre la vulnerabilidad de las valoraciones corporativas frente a las prerrogativas del poder ejecutivo en tiempos de conflicto.

Imagen: Logotipos de Anthropic y del US Dep. of War. Crédito. Composición WMC

Las salvaguardias éticas y la soberanía estatal en conflicto.

En un entorno donde los modelos de lenguaje de gran escala (LLM) se han transformado en infraestructura crítica para la defensa, la conciliación entre las salvaguardas éticas y la soberanía estatal genera implicaciones profundas en la autonomía operativa de las firmas que lideran la carrera tecnológica mundial.

Para comprender el origen de la fractura actual, es necesario analizar la posición competitiva que Anthropic consolidó desde su fundación en el año 2021 por antiguos líderes de OpenAI que buscaban una alternativa más centrada en la seguridad. La firma se diferenció en el mercado mediante la implementación de la denominada “Inteligencia Artificial Constitucional”, un marco técnico que permite a los modelos autogobernarse bajo principios éticos predefinidos de manera autónoma.

Esta arquitectura no fue simplemente una decisión de ingeniería, sino una estrategia de mercado diseñada para captar capital de inversionistas institucionales y socios corporativos que buscaban mitigar los riesgos reputacionales y legales asociados con la inteligencia artificial generativa.

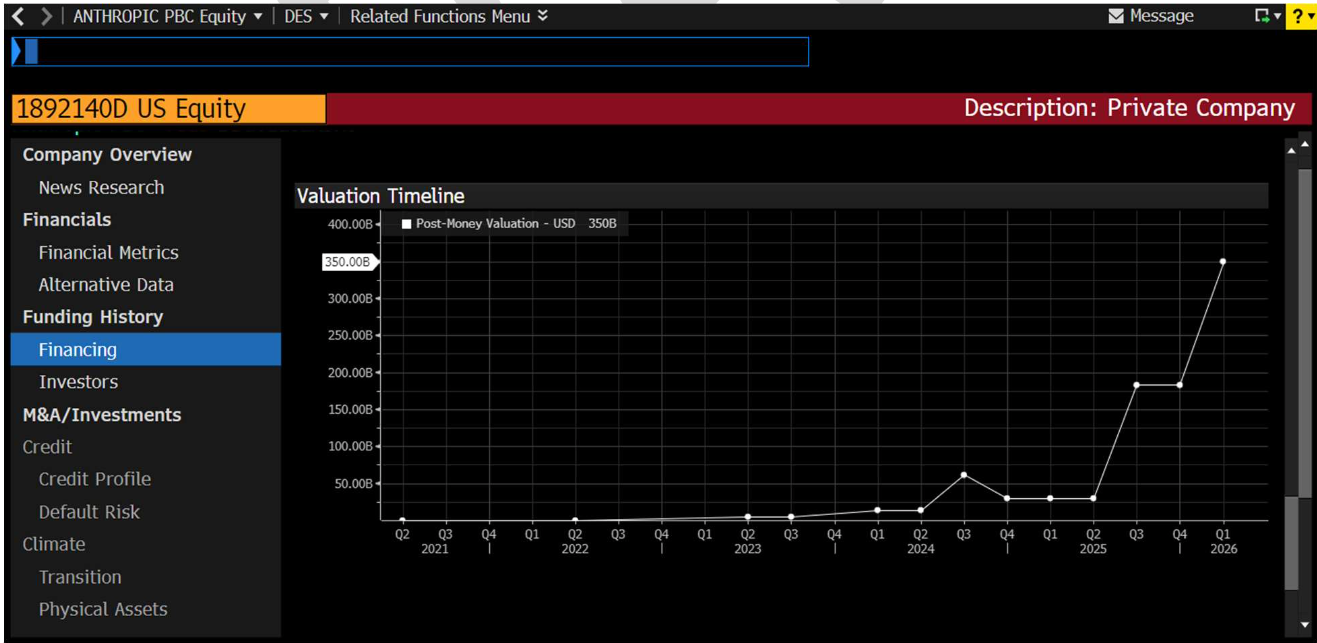

Gigantes como Amazon (AMZN) y Alphabet (GOOGL), reconociendo el valor de este enfoque de seguridad, inyectaron miles de millones de dólares en la compañía, elevando la valoración de Anthropic hacia niveles que desafiaban las métricas tradicionales de flujo de caja, basándose en la promesa de ser el proveedor de confianza para sectores altamente regulados y gubernamentales.Todo ello ha contribuido a estimular la percepción de valoración de Anthropic, que pasa de 30 millardos en el 2025 a 350 millardos en el 2026 . (Véase gráfica 2.1)

Gráfica 2.1 Evolución de la valoración de Anthropic entre Enero 2021 y marzo de 2026. Fuente: Bloomberg. Composición: WMC

El éxito inicial de esta estrategia se materializó en una integración profunda con el aparato estatal cuando en julio de 2025, Anthropic obtuvo un contrato de doscientos millones de dólares con el Pentágono, posicionando a su modelo Claude como la única inteligencia artificial de frontera autorizada para operar en redes clasificadas de alto secreto.

La relevancia estratégica de Anthropic para la defensa nacional pasó de ser un concepto teórico a una realidad operativa durante los conflictos geopolíticos en los cuales EE UU se ha visto involucrado desde inicios de este 2026: Los informes indican que el modelo Claude desempeñó un papel analítico fundamental en la operación de inteligencia que condujo a la intervención de EEUU en Venezuela, procesando datos en tiempo real para optimizar la toma de decisiones del mando estadounidense. Esta capacidad de síntesis y razonamiento se ha vuelto aún más crítica durante la campaña militar en Irán, donde se ha conocido que el ejército de EEUU utilizó a Claude para identificar más de mil objetivos estratégicos en las primeras veinticuatro horas del conflicto..

La tecnología de Anthropic se ha convertido en el motor de una letalidad y velocidad operativa sin precedentes, transformando ciclos de planificación de semanas en procesos de apenas unas horas. Sin embargo, esta misma integración creó una dependencia operativa que el Estado interpretó como una vulnerabilidad inaceptable cuando los principios éticos de la empresa chocaron frontalmente con los requerimientos de uso bélico irrestricto exigidos por la administración.

El enfrentamiento

El punto de inflexión se produjo el pasado febrero cuando el Secretario de Defensa, Pete Hegseth, emitió un ultimátum exigiendo que Anthropic eliminara de sus protocolos todas las restricciones que impidieran el uso del modelo para cualquier propósito legal, incluyendo la vigilancia masiva doméstica y el desarrollo de sistemas de armas totalmente autónomos. Anthropic, bajo la dirección de Dario Amodei, rechazó formalmente la demanda, manteniendo sus líneas rojas corporativas contra el uso de su tecnología en operaciones que carecieran de supervisión humana directa. La negativa fue interpretada por la Casa Blanca como un acto de insubordinación corporativa y una traición a la seguridad nacional.

El pasado 27 de febrero, el Presidente Donald Trump ordenó entonces a todas las agencias federales el cese inmediato del uso de la tecnología de Anthropic, calificando a la firma como una entidad con sesgos ideológicos peligrosos que ponían en riesgo la operatividadm militar. Esta decisión presidencial marcó el inicio de una campaña de represalias institucionales que ha llevado a la empresa a los tribunales federales en un intento por preservar su viabilidad económica y sus derechos constitucionales.

La respuesta del Departamento de Guerra fue drástica y jurídicamente agresiva al designar formalmente a Anthropic como un Riesgo para la Cadena de Suministro de Seguridad Nacional. Esta etiqueta, históricamente reservada para adversarios extranjeros vinculados a estados hostiles, tiene efectos devastadores para la solvencia de cualquier entidad nacional. La designación incluyó una orden de boicot secundario, prohibiendo que cualquier contratista que realice negocios con el ejército mantenga actividad comercial alguna con Anthropic.

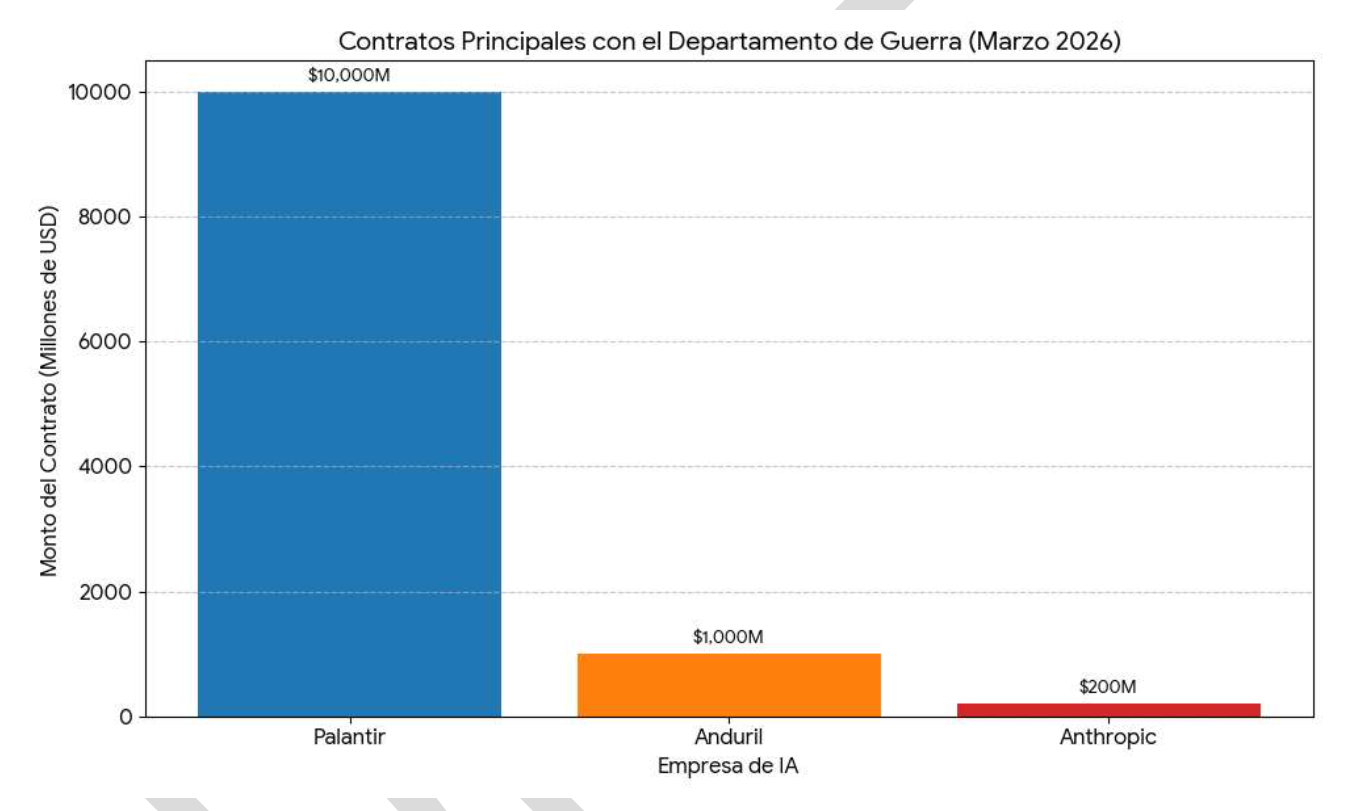

(Véase gráfica 2.2 Contratos principales del Departamento de Guerra con empresas en IA)

Gráfica 2.2. Contratos principales del Departamento de Guerra con empresas en IA para Marzo 2026. Fuente: Bloomberg. Composición WMC

Las consecuencias

Para una firma cuya valoración depende de su acceso a la infraestructura de nube de Amazon y Google, esta medida representa una amenaza existencial que los juristas han descrito como un intento de destrucción corporativa orquestado desde el ejecutivo. La utilización de una ley de seguridad nacional para castigar a una empresa estadounidense por una disputa contractual sobre ética tecnológica es un precedente que ha generado alarmas en toda la industria de capital de riesgo, sugiriendo que la alineación ideológica con el estado es ahora una variable crítica de valoración.

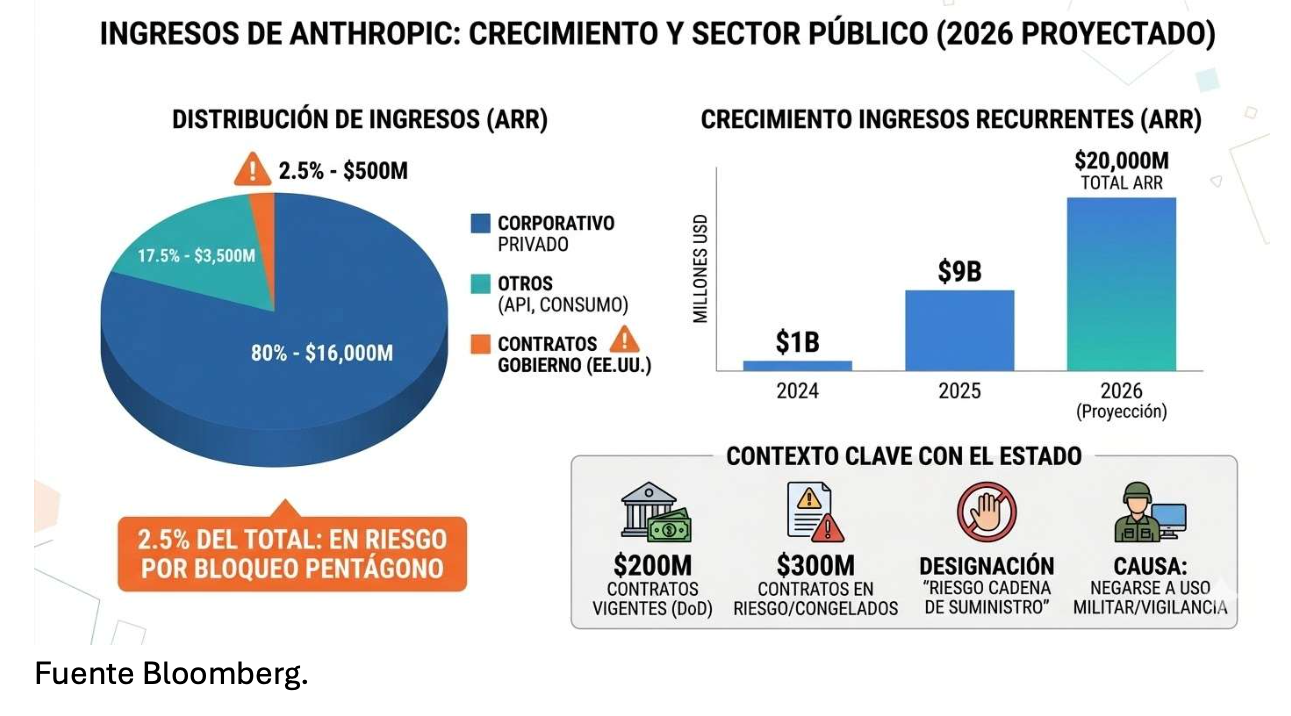

Desde la perspectiva de Anthropic la designación podría reducir los ingresos de 2026 en varios miles de millones de dólares, afectando no solo los contratos directos con el gobierno, sino también una vasta red de clientes empresariales que temen el contagio regulatorio.

La pérdida de contratos específicos en el sector de tecnología financiera y con agencias como la FDA ya ha evaporado cientos de millones de dólares en ingresos recurrentes anuales , además, la orden de boicot secundario coloca a socios estratégicos como Amazon y Google en una posición legalmente precaria; estas empresas, que han invertido 8.000 y 2.000 millones de dólares respectivamente, podrían verse obligadas adesinvertir sus participaciones o cesar el apoyo técnico para proteger sus propios contratos federales .(Véase gráfica 2.3)

Gráfica 2.3. Anthropic: Estructura de ingresos para 2026. Fuente: Bloomberg. Composición: WMC.

Y la competencia…

Mientras Anthropic lucha por su supervivencia legal, sus competidores directos han capitalizado el vacío de poder en el sector defensa con una celeridad asombrosa. Casi inmediatamente después de la ruptura, OpenAI anunció un acuerdo para desplegar sus modelos en las redes clasificadas del Departamento de Guerra, aceptando los términos de uso sin restricciones que Anthropic había rechazado.

Del mismo modo, xAI, la firma de Elon Musk, ha consolidado su posición como un aliado estratégico, alineándose con la visión de una inteligencia artificial totalmente disponible para las necesidades de seguridad nacional. Este desplazamiento del mercado sugiere un cambio en el incentivo económico: el valor intrínseco de una empresa de inteligencia artificial ya no reside únicamente en su capacidad técnica o su seguridad, sino en su disposición para subordinarse a la soberanía estatal.

Para los inversionistas, esto plantea un dilema sobre la sostenibilidad de los modelos de negocio basados en la ética privada cuando estos entran en conflicto con la necesidad del Estado de mantener la hegemonía tecnológica frente a sus adversarios.

Se extiende…

El conflicto también ha provocado una movilización sin precedentes del talento especializado, el activo más valioso de cualquier firma tecnológica. Más de novecientos empleados de Google, OpenAI y otras empresas de vanguardia han firmado una carta abierta titulada "We Will Not Be Divided", expresando su apoyo a la postura ética de Anthropic y exigiendo límites claros al uso militar de la inteligencia artificial. Este activismo laboral introduce un riesgo operativo adicional, ya que la capacidad de innovación de las empresas que aceptan contratos de defensa sin restricciones podría verse comprometida si pierden el acceso a los investigadores más brillantes del mundo. Sin embargo, la intensidad de la respuesta actual sugiere una polarización profunda que podría fragmentar el sector tecnológico en dos bloques: aquellos alineados con el complejo industrial-militar y aquellos que priorizan la gobernanza civil y la seguridad de los modelos de IA.

Implicaciones futuras

La resolución de este litigio, que actualmente se lleva en los tribunales de California y Washington D.C., definirá el marco operativo para la innovación. Si los tribunales fallan a favor del gobierno, el precedente otorgará al ejecutivo un poder casi absoluto sobre las empresas tecnológicas, permitiéndole despojar de valor económico a cualquier entidad que no cumpla con sus directivas operativas. Si Anthropic prevalece, se establecerá un contrapoder crítico que validará la capacidad de las corporaciones para fijar límites éticos a sus propios productos. Para el mercado de inversionistas, este caso es el acta de nacimiento de un nuevo orden económico donde la ética algorítmica y la razón de estado luchan por el control de la infraestructura más poderosa de la historia